La visite du salon Laval Virtual me fait monter en tête de nombreuses questions sur l’avenir des interfaces avec les dispositifs informatiques. En effet, elles ont pour la plupart disparues des stands cette année, remplacées par la Kinect de Microsoft. La tendance générale est donc à l’utilisation du corps comme élément naturel de contact.

Dans le domaine de la réalité augmentée, on n’échapera pas au phénomène en gardant cependant à l’esprit que les informations virtuelles superposées au réel, doivent d’une façon ou d’une autre, atteindre l’oeil des utilisateurs. On peut alors distinguer deux objectifs. Soit on veut que les élements soient visibles de plusieurs personnes, en permettant par exemple une interaction collective. Soit on imagine des informations unipersonnelles.

Dans le domaine de la réalité augmentée, on n’échapera pas au phénomène en gardant cependant à l’esprit que les informations virtuelles superposées au réel, doivent d’une façon ou d’une autre, atteindre l’oeil des utilisateurs. On peut alors distinguer deux objectifs. Soit on veut que les élements soient visibles de plusieurs personnes, en permettant par exemple une interaction collective. Soit on imagine des informations unipersonnelles.

Dans le premier cas, il semble assez pertinent de passer par des projections. Nous avons déja des exemples d’utilisation de ce genre, dans le tourisme. Il reste « juste » à travailler sur les problèmes d’occultation.

Pour le cas personnel par contre, le problème de l’interface est plus complexe. Aujourd’hui la plupart des applications se basent sur la webcam+écran ou sur le smartphone. Comment les faire disparaitre ? Les lunettes actives sont une possibilité, comme nous l’avons vu sur le stand de Laster. Elles permettent d’utiliser un objet du quotidien comme support. Il reste à les rendre encore plus légères et, peut être, à y incorporer directement une unité de traitement des données autonomes. Ce n’est qu’un problème technique de miniaturisation. En attendant cela, les lunettes peuvent n’être qu’un système de visualisation couplé à un smartphone (par bluetooth).

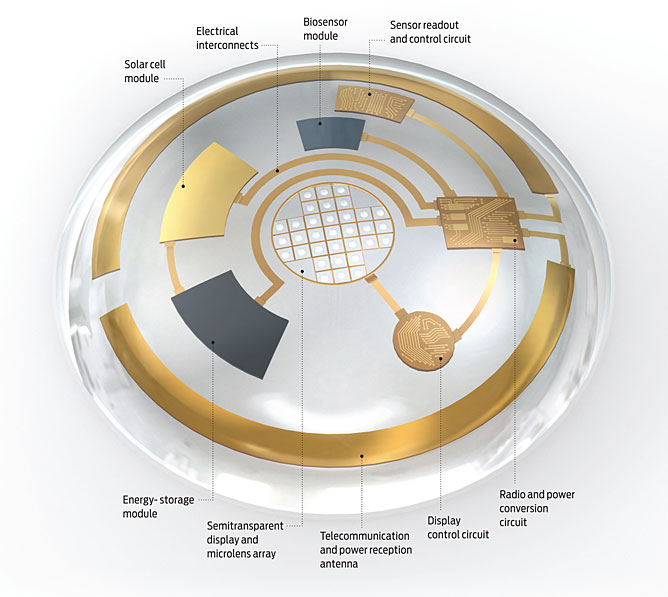

Mais que faire pour aller plus loin ? On parle régulièrement de lentilles électroniques comme support discret. Le devellopement de ces objets reste à faire et même dans ce cas, ce n’est qu’une sorte de miniaturisation extrème des lunettes … Si on veut s’affranchir complètement de l’interface, il faut pouvoir apporter l’information virtuelle directement au niveau nerveux et/ou cérébrale. Je ne connais pas l’état de l’art dans ce dommaine mais le physicien que je suis ne peut s’empécher de penser que tout cela, après tout, ce n’est que de l’électricité 🙂

Mais que faire pour aller plus loin ? On parle régulièrement de lentilles électroniques comme support discret. Le devellopement de ces objets reste à faire et même dans ce cas, ce n’est qu’une sorte de miniaturisation extrème des lunettes … Si on veut s’affranchir complètement de l’interface, il faut pouvoir apporter l’information virtuelle directement au niveau nerveux et/ou cérébrale. Je ne connais pas l’état de l’art dans ce dommaine mais le physicien que je suis ne peut s’empécher de penser que tout cela, après tout, ce n’est que de l’électricité 🙂

Evidemment si on ajoute des informations directement dans la partie visuelle de notre cortex, on peut se demander qu’est-ce qu’on pourra encore définir comme réalité… Mais c’est un autre débat !!

Grégory MAUBON est consultant indépendant en réalité augmentée (animateur et conférencier) depuis 2008, où il a créé www.augmented-reality.fr et fondé en 2010 RA'pro (l'association francophone de promotion de la réalité augmentée). Il a aidé de nombreuses entreprises (dans plusieurs domaines) à définir précisément leurs besoins en réalité augmentée et les a accompagnées dans la mise en œuvre.